聊聊 GPU 产品选型

随着近年来的人工智能的快速崛起,你可能对ChatGPU还记忆犹新,对国内的百模大战也有耳闻,前阵子漂亮国针对我们对高端

GPU的限售可能也历历在目。这些都在揭示了一个对算力需求的时代已经来临,未来不夸张的说,算力是第一生产力。哈哈,命题有些大了。

我们回到主题吧,今天从我对GPU的了解,来聊下GPU如何选型。

一、GPU都有那些应用场景

游戏和图形渲染:

其实最早GPU发明的初衷就是做图形渲染的,GPU可以处理复杂的图形渲染任务,可以使游戏画面更加逼真和流畅。

大模型计算

大模型训练需要处理海量数据和复杂的计算任务,如深度神经网络的训练。而GPU拥有强大的计算能力和优化的张量计算指令集,可以加速大规模模型的训练过程,减少训练时间。

AI推理

所谓AI推理使在训练好的模型基础上进行实时推断和预测,推理任务主要涉及张量计算,包括矩阵乘法和卷积操作等。现在的GPU都有 Tensor Core,可以把整个矩阵放到寄存器里批量运算,提升十几倍的效率。

高性能计算

比如科学计算、数值模拟、天气预报等需要大规模的并行计算领域,则需要大量的CUDA核心和高内存带宽,才可以实现搞笑的并行计算,同时也需要GPU具有良好的双精度浮点性能和高速的数据传输能力。

二、GPU的重要指标的参数情况

1、计算能力,

也是GPU核心能力,主要涉及的指标有:

FP64:双精度浮点数,科学计算、工程模拟和需要高精度计算的应用中常常使用到。

FP32:单精度,作为训练场景的数据格式的标准值,许多机器学习和深度学习任务中使用到。

TF32:从A100开始

英伟达提出的数据格式,比FP32精度低,比FP16 精度高,主要用于深度学习训练,理论上比混合精度效果更好。

BF16:Intel x86、ARM采用的,用于机器学习和深度学习领域

FP16:半精度浮点数,具有高算速,低存储特征,主要用于推理

INT8:是一种使用 8 位内存来表示证书的数据类型,相对于浮点计算具有更高的效率,主要用于推理。

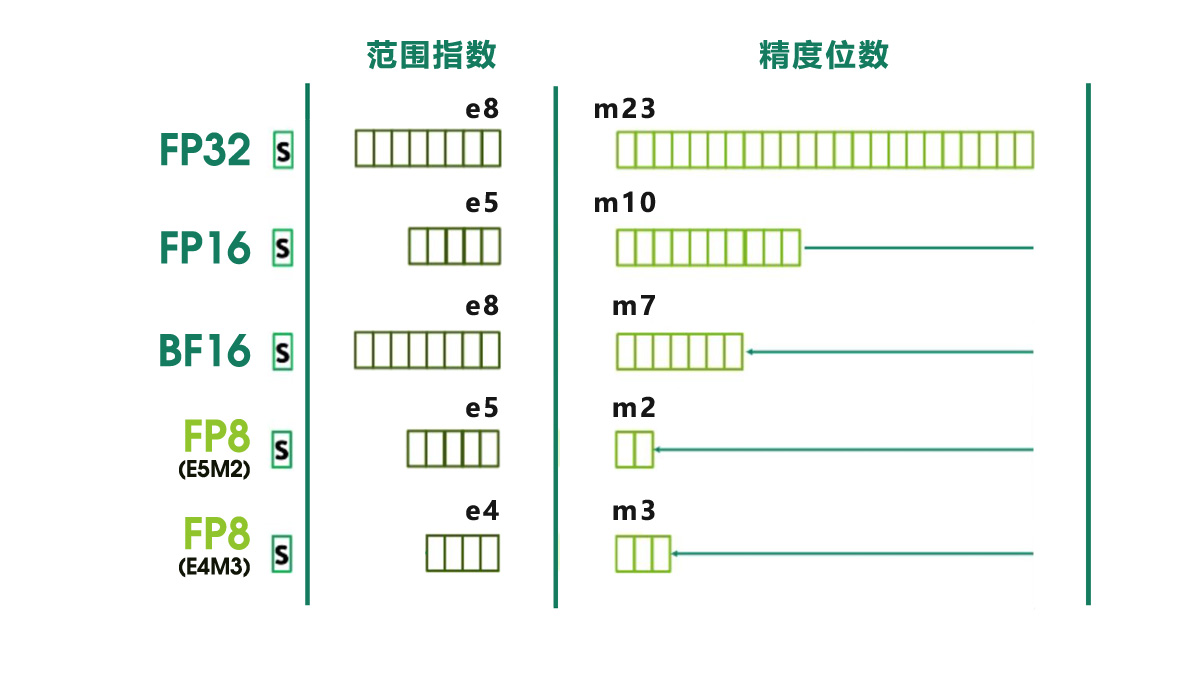

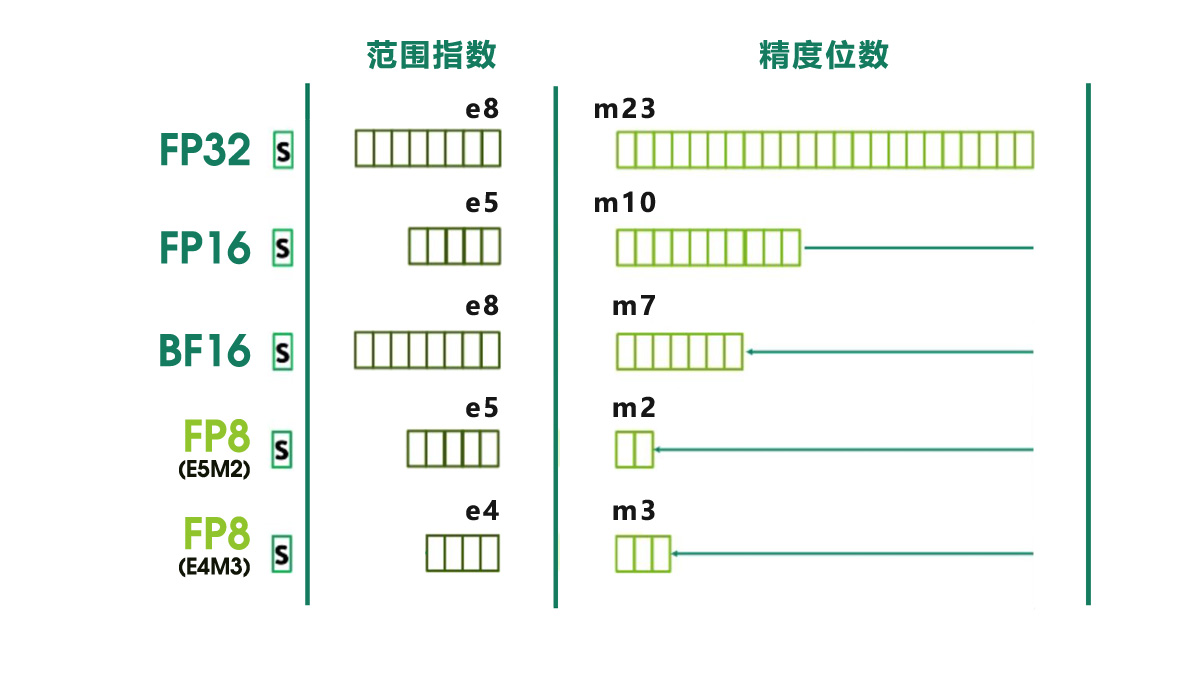

以上参数,我们以FP32为例,用这张图来方便理解:

FP32 长度有 32 位,其中指数位占 8 位,精度尾数占 23 位,最前面是标志位。指数位越大,代表数值越大,精度的长度越多,表示小数点后的精度越高。

2、显存容量

是 GPU 用于存储模型参数、计算中间结果和图像数据等的内存。显存容量的大小直接影响着能否加载和处理大规模的数据和模型。

3、CUDA Core

CUDA Core 是 NVIDIA GPU 上的计算核心单元,用于执行通用的并行计算任务,按照英伟达的说法,我理解CUDA Core 数量,实际就是 FP32 计算单元的数量。

4、Tensor core

专门用于深度学习任务中的张量计算

5、接口形式

分 SXM 和 PCIe 两种不同的接口,SXM 接口直接将 GPU 连接到主板上,PCIe 接口通过插槽与主板连接,SXM 接口提供高带宽低延迟,用于高性能计算和数据中心需求;PCIe 接口应用于个人计算机、工作站和服务器等设备

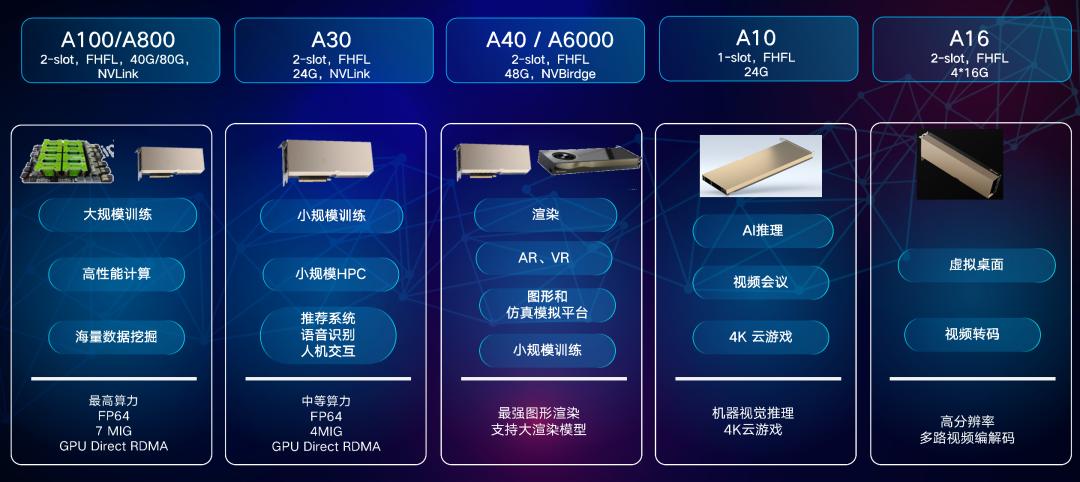

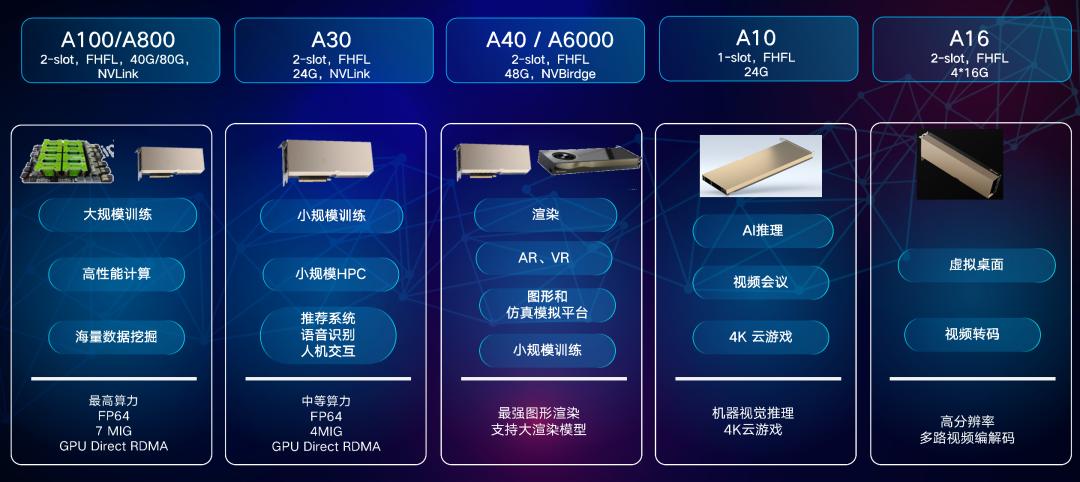

三、NVIDIA 几款A系列 GPU的简单对比

从这里,我们可以看出,

A100/

A800主要用大规模训练、高性能计算和海量数据挖掘

A30用于小规模训练、小规模的HPC、以及推荐系统、语音识别和人机交互场景

A40则适用于渲染、AR\VR、图形和方正模拟平台以及小规模训练

A10主要用于AI推理、视频会议、4K云游戏等领域

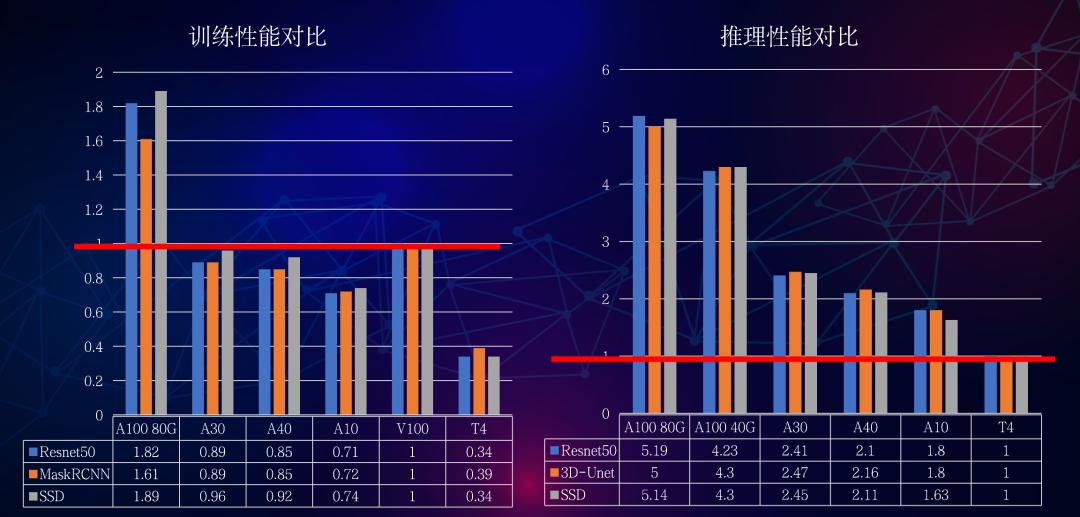

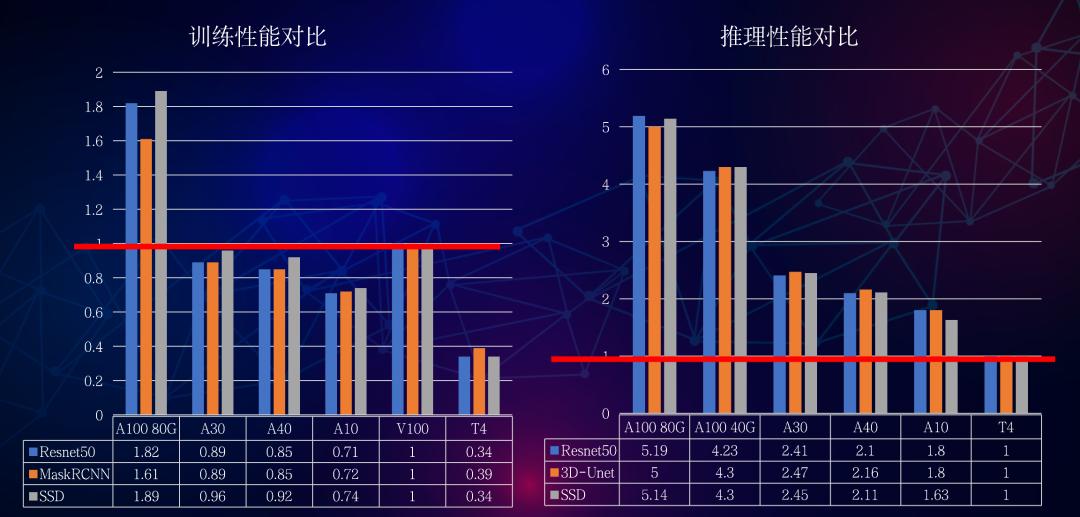

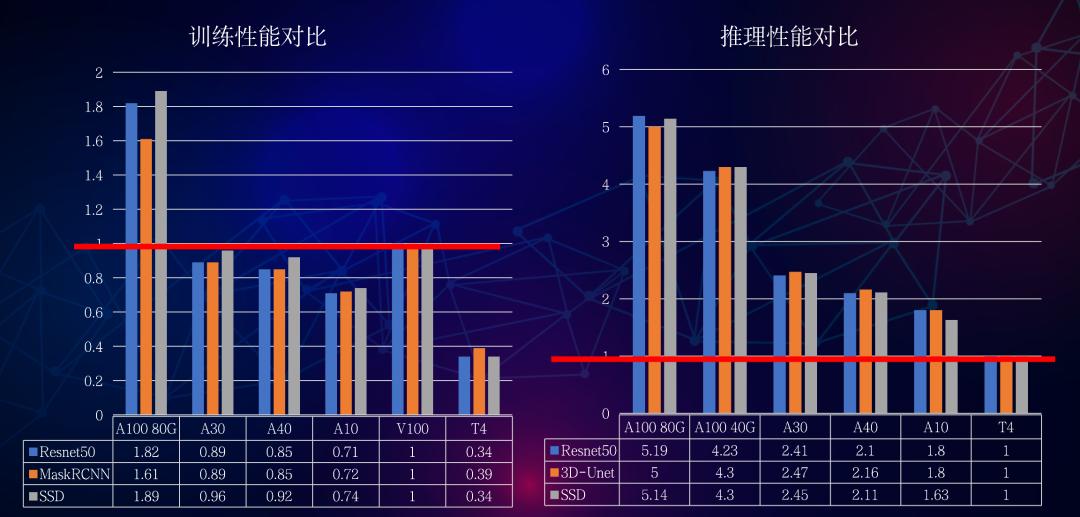

下面,再看下训练性能和推理性能,各卡的测试指标对比

以上图片来源于互联网,侵删

相信看到这里,大家对 GPU 产品选型已经有了一定的想法。在选择时,大家可以参考 GPU 制造商的官方文档、性能比较表等资源,以获取更详细的信息和比较不同 GPU 之间的性能特点。当然最重要的是要明确自身业务的计算需求和任务类型啦。

以上内容来源于 https://www.xujun.org/note-167063.html,做有部分改动,如有侵权,随时可以删除。非常感谢!