当我们选择GPU服务器配置与方案时,有几个关键因素需要考虑:

GPU型号

目前市场上有许多不同型号的GPU可供选择,例如NVIDIA的Tesla A100、

A800、RTX 4090等。对于需要高精度计算的科学计算任务,通常需要使用支持双精度浮点数运算的显卡,如

NVIDIA A800 A30等用于科学计算的显卡。这些显卡通常具有更高的计算能力和更大的显存,能够满足科学计算中对精度和性能的要求。而RTX 4090具有高性能的单精度计算能力和大容量的显存,可以提供快速的计算和训练速度;不同的GPU型号具有不同的计算能力和内存容量,因此需要根据实际需求选择合适的型号。

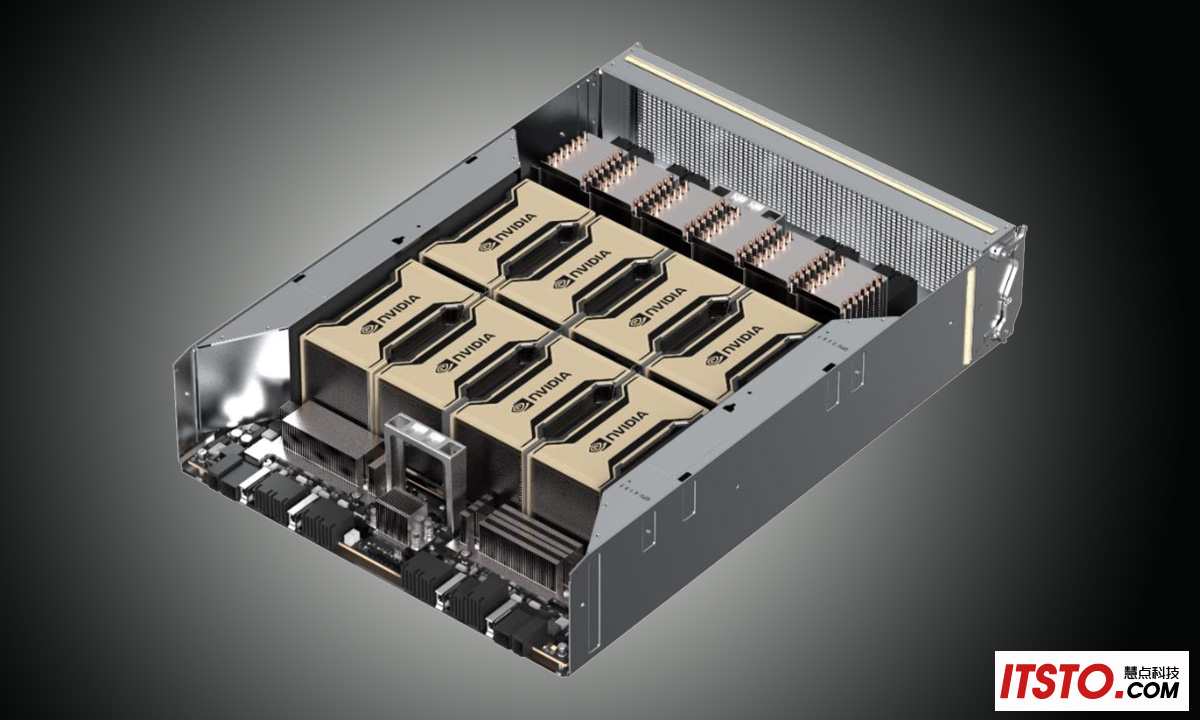

GPU数量

根据任务的复杂性和并行计算需求,可以选择单个或多个GPU。多个GPU可以提供更高的计算性能,但也需要考虑功耗和散热等问题。

CPU和内存

GPU服务器通常需要配备强大的

服务器CPU和足够的内存来支持

GPU的计算需求。选择高性能的多核CPU和足够的内存容量可以确保系统的整体性能。

存储和网络

根据实际需求选择适当的存储和网络配置。如果需要处理大量的数据,可以选择高速的固态硬盘(SSD)或网络存储(NAS)来提高数据访问速度。对于需要进行大规模数据传输的任务,可以选择具有高带宽和低延迟的网络接口。

散热和功耗

GPU服务器通常会产生大量的热量,因此需要考虑散热系统的设计和功耗管理。选择具有良好散热性能的服务器机箱和风扇,以及高效的电源供应,可以确保系统的稳定性和可靠性。

总的来说,选择GPU服务器配置方案时需要根据实际需求和预算考虑各种因素,并选择合适的GPU型号、数量、CPU、内存、存储和网络配置,以及良好的散热和功耗管理。建议在选择之前咨询专业的硬件供应商或咨询顾问,以获取更具体的建议和推荐。

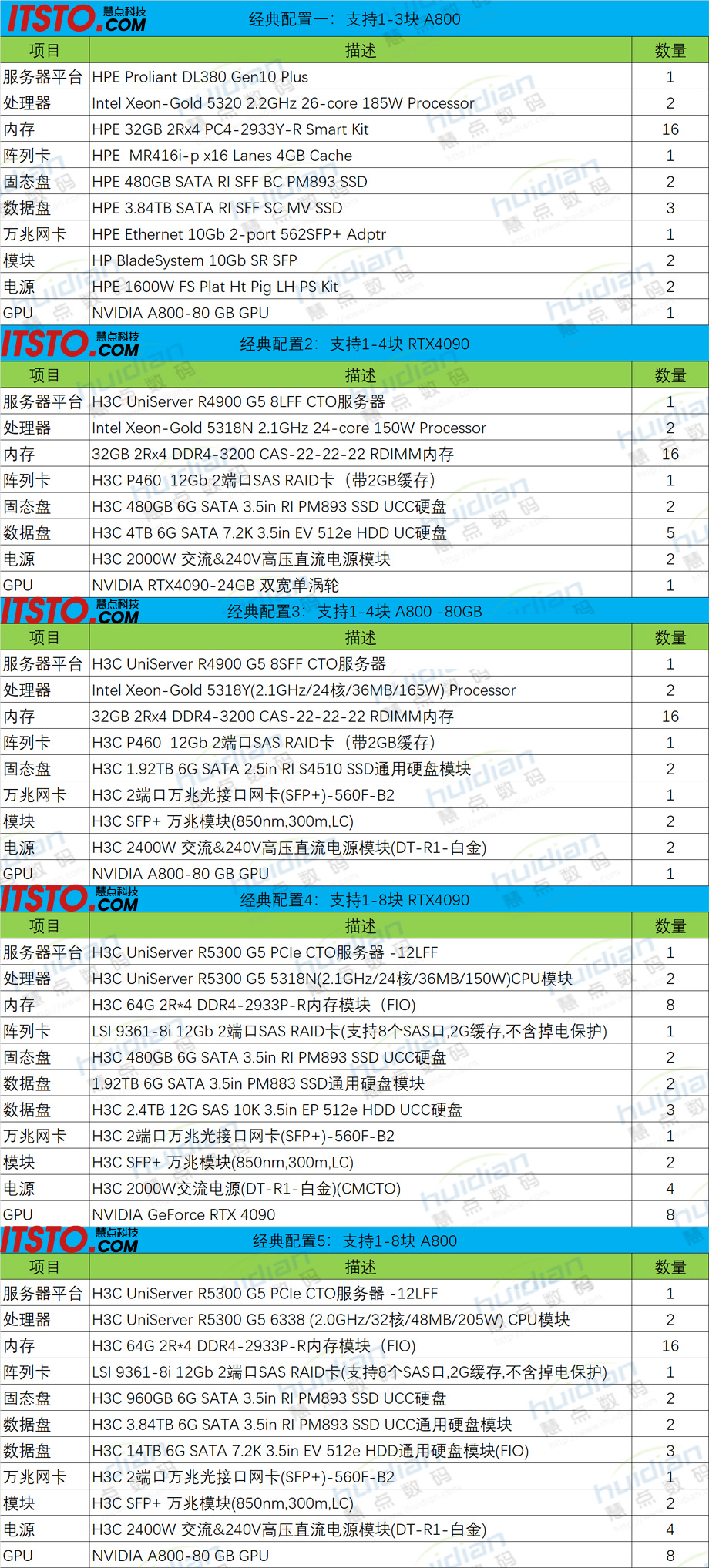

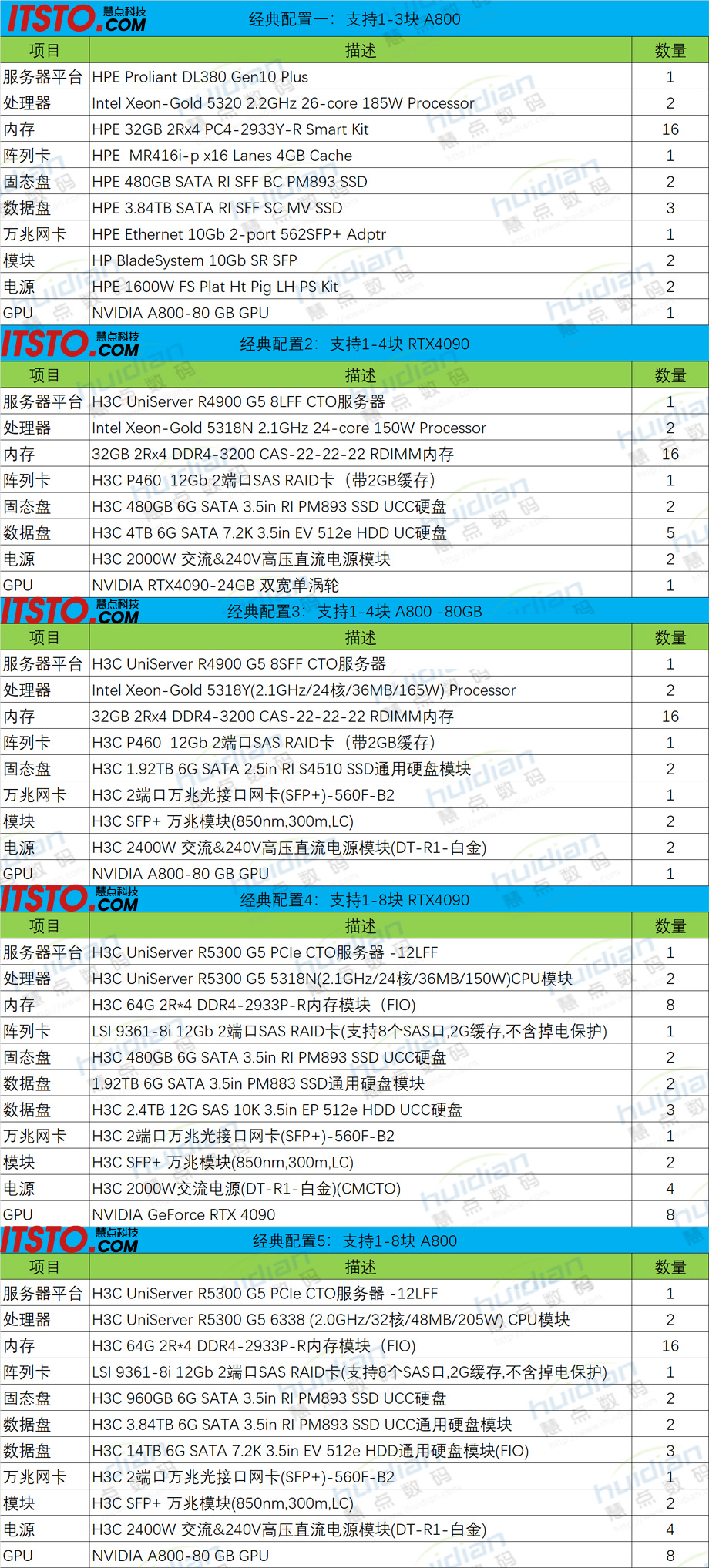

下面给几个最为常见经典的GPU服务器配置方案,希望对您选择GPU服务器配置时有所帮助: